Ziel dieses Vorhabens ist es, Verfahren zu entwickeln, die aus mehreren Ansichten einerseits

Ziel dieses Vorhabens ist es, Verfahren zu entwickeln, die aus mehreren Ansichten einerseits

stabilere Analyseergebnisse liefern und andererseits die durch die Aufnahmegeometrie gegebenen

Schwächen beseitigen. Zusätzlich sind Algorithmen zu entwickeln, die aus den Ansichten 3DInformationen

ableiten und diese mit Ergebnissen aus interferometrischen 3D-Bestimmungen

vergleichen.

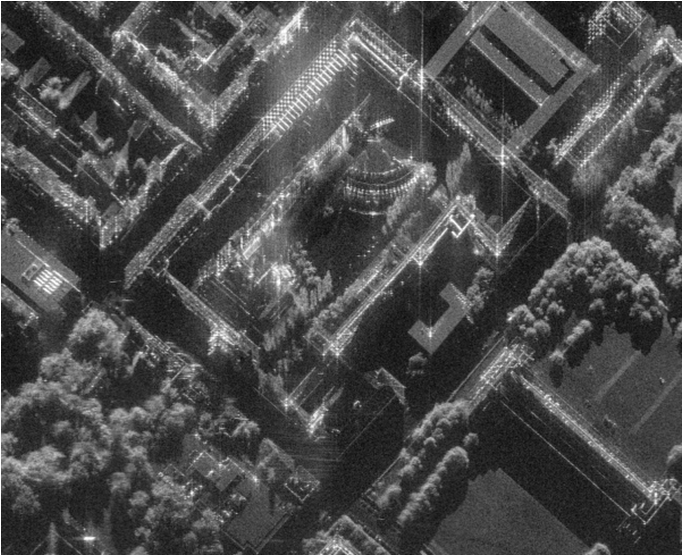

Abbildende Radarsysteme mit synthetischer Apertur (SAR) erlauben gegenüber passiven Systemen

im sichtbaren Spektralbereich eine Beobachtung der Erdoberfläche zu jeder Tages- und

Nachtzeit und dies wetterunabhängig. Monostatisches SAR setzt prinzipiell eine schräge Beleuchtung

einer ebenen Szene voraus. Dadurch treten bei erhabenen Objekten abhängig vom Beobachtungswinkel

unerwünschte Verdeckungen und Signalüberlagerungen auf. Diese Problematik

trifft besonders für Gebäude in dichten urbanen Gebieten auf, die durch hoch aufgelöste SARBilder

aufgenommen werden. Nimmt man SAR-Bilder aus verschieden Richtungen auf, so können

redundante Informationen zur Steigerung der Zuverlässigkeit bei der Objektextraktion beitragen

und nichtredundante Informationen zu einer Vervollständigung der Szenenbeschreibung führen.

Ziel dieses Vorhabens ist es, Verfahren zu entwickeln, die aus mehreren Ansichten einerseits

stabilere Analyseergebnisse liefern und andererseits die durch die Aufnahmegeometrie gegebenen

Schwächen beseitigen. Zusätzlich sind Algorithmen zu entwickeln, die aus den Ansichten 3DInformationen

ableiten und diese mit Ergebnissen aus interferometrischen 3D-Bestimmungen

vergleichen.